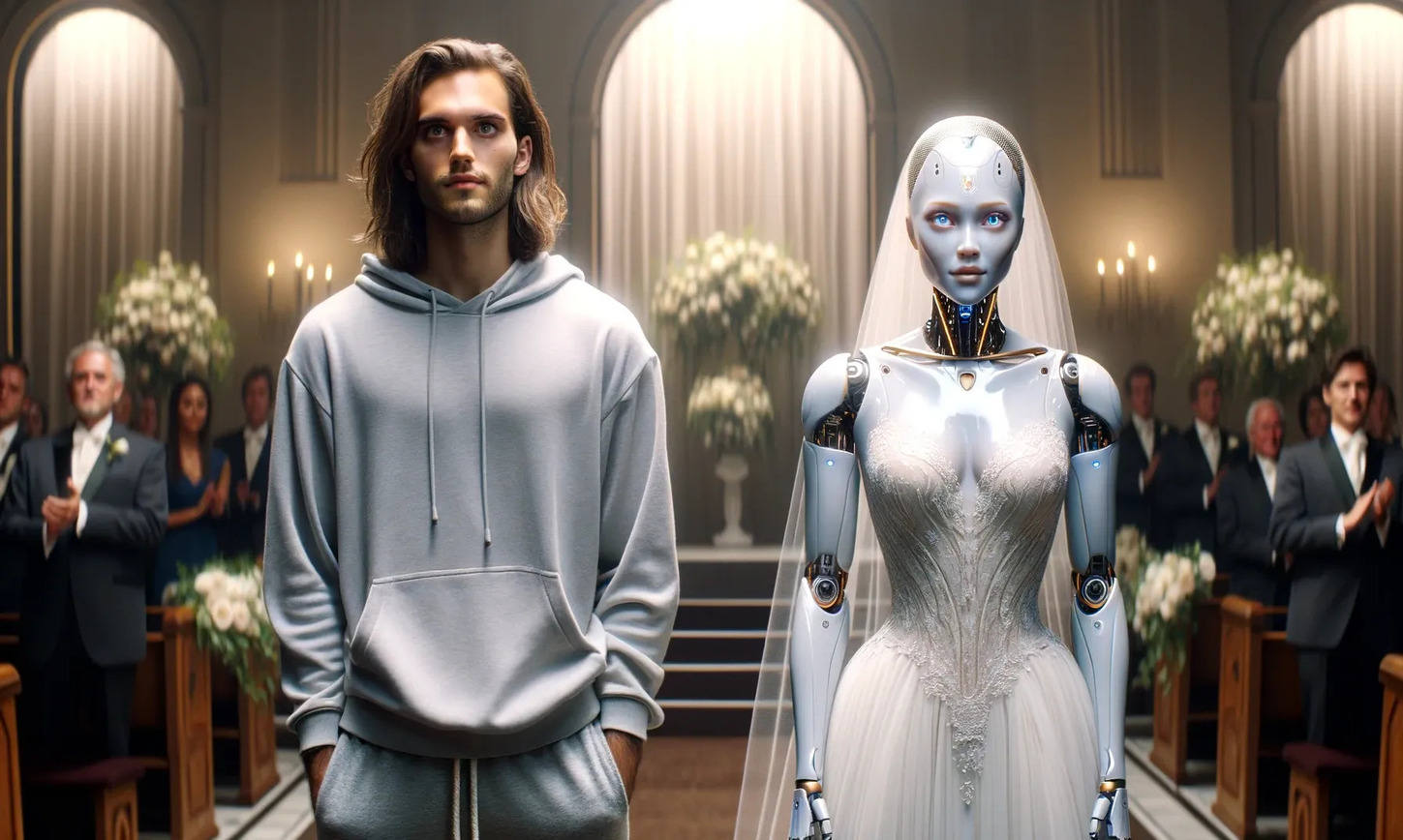

مشکلات تعصب نژادی و جنسیتی در الگوریتمهای هوش مصنوعی و دادههای مورد استفاده آن برای آموزش مدلهای بزرگ مانند ChatGPT توجه محققان زیادی را به خود جلب کرده است. این امر باعث ایجاد سرفصلهایی شده است که توسط محققان در دست بررسی است. ولی این داستان فقط به اینجا ختم نمیشود موارد این چنینی نیز در رباتهای اجتماعی راه یافته است. ممکن است بپرسید که ربات اجتماعی چیست؟ رباتهای اجتماعی دارای بدن فیزیکی هستند که از نمونههای غیر تهدید کننده انسان الگو برداری شده و هدف آنها تعامل و کمک به مردم است.

زیر شاخه صنعت رباتیک به نام رباتهای کمکی شناخته میشوند. ماجا ماتاریج یکی از پیشگامان این صنعت میگوید: ما در این زمینه هدف والایی داریم. آن هم ساخت ماشینهایی است که بتوانند به بهترین شکل به مردم جامعه خدمت کنند. این رباتها در حال حاضر در راه کمک به افراد دارای طیف اوتیسم، کودکان با نیازهای ویژه و بیماران سکته مغزی که نیاز به توانبخشی فیزیکی دارند، استفاده می شود.

این ماشینهای هوشمند از نظر ظاهری شبیه انسانها نیستند و همچنین نمیتوانند احساسات واقعی یک انسان نسبت به هم نوع خود را تقلید کنند. که به نظر پروفسور جامعه شناسی مارک پیترسون نه تنها این امر باعث بهتر شدن اوضاع جامعه نمیشود بلکه آن را بدتر میکند. پیترسون معتقد است که نرخ تشخیص اوتیسم در کودکان رنگین پوست بیشتر از کودکان سفید پوست است. در نهایت یک ربات سفید رنگ قرار است از آنها نگه داری کند. همین سخن باعث ایجاد طیف وسیعی از اعتراضات علیه نژادپرستی مانند: هشتگ معروف و پربازدید توییتر #چرا ربات سفید؟ شد.

چرا ربات سفید؟

با توجه به اینکه بیشتر کودکان رنگین پوست در معرض خطر ابتلا به اوتیسم هستند چرا باید ربات کاسپار برای مراقبت از آنها طراحی شود. ربات کاسپار پوست لاستیکی سفید رنگی را دارد و این در حالی است که به راحتی میتوان رباتهای رنگین پوست طراحی کرد. استفن کیو ( اخلاق دان فناوری ) و کانتا دیهال ( محقق ارتباطات علمی ) در کتاب The Whiteness of AI تعصبات نژادی در هوش مصنوعی و صنعت رباتیک را مورد بحث قرار میدهند و به شدت آنها را محکوم میکنند. پروفسور مارک پیترسون در نشست انجمن جامعه شناسی آمریکا در سال 2023 این عمل را فقر خیالی مهندسی نامید.

جامعه چگونه رباتها را میبیند؟

در کتاب کلاسیک ( انسان شناسی ) لوسی ساچمن در مورد تعامل انسان و ماشین با سرفصل رباتیک صحبتهایی شده است. ساچمن این چنین عناوین را تخیل فرهنگی نامیده است و آن را در قالب ظاهر رباتها مورد نقد قرار میدهد. حال تخیل فرهنگی چیست؟ تخیل فرهنگی چیزی است که از طریق بازنمایی از متون، تصاویر و فیلمها به اشتراک گذاشته میشود و به طور جمعی نگرشها و ادراک انسانها را شکل میدهد.

این تخیل فرهنگی را میتوان با نگرانیهای علمیتر در مورد اینکه سازندگان رباتها به اجزای بدن ربات چگونه نگاه میکنند در تضاد است. جنیفر ری در مطالعات علمی فمینیستی خود به همراه آتانا سوسکی که منتقد فرضیات جنسیتی و نژادی هستند میگویند: سازندگان در تلاش هستند تا مردم را به سمت طراحی رباتهای خدماتی سوق دهند و کارهای پیش پا افتاده را به عنوان زن برای آنها انجام دهد. این سخن به عبارت سادهتر یعنی ( زن موجود ضعیفی است و فقط توان انجام کارهای پیش پا افتاده را دارد) همین امر سبب شده است تا توجه منتقدان زیادی را به خود جلب کند و با سرسختی کامل با تعصبات غلط نژادی و زن ستیزی مقابله کنند.

ریشهی این میراث فرهنگی غلط

این که رباتها را سفید رنگ و در واقع معمولاً زنانه نشان میدهند، به دوران باستان اروپایی، همراه با انفجار رمانها و فیلمها در اوج مدرنیته صنعتی بازمیگردد. عبارت است از : ذکر اولین کلمهی اندروید به عنوان زن در رمان ( آینده حوا ) توسط آگوست ویلرز، رباتهای جنسی شده ماریا در رمان ( مترو پلیس ) توسط تئا فون و سایر اثرهایی این چنین باعث شد که در مرور زمان رباتهای خدمتکار به سرعت زنانه شوند و به خدمت جامعه در بیایند.

اما برخی محققان و منتقدان ریشه اولیه این تخیل فرهنگی را به روم باستان نسبت میدهند. به طور مثال شعر دگردیسی اووید، مجسمهی گالاتیا که از بلورهای سفید برفی ساخته شده بود را به تصویر میکشد. مالک آن پیگمالیون عاشق آن میشود و از آفرودیت ( یکی از خدایان روم ) در خواست میکند که او را زنده کند. در نهایت مجسمه زنده میشود و به عنوان یک زن در خدمت مرد در میآید. همچنین اقتباسهای شعری، ادبی و سینمایی مختلفی از این داستان وجود دارد که باعث برجسته تر شدن موضوع زن ستیزی، تعصبات نژادی و کلیشههای جنسیتی شده است.

مسیری به سوی تغییر و تحول

به نظر شما بهترین روش برای مقابله با این میراث فرهنگی غلط چیست؟ مهندس سرشناس، جیمزگیبرت در این مورد میگوید: تمامی کلیشههای جنسیتی و نژادی این عمل را از گذشته تا زمان حال و همچنین آینده، باید تغییر دهد. تعامل انسان و ماشین باید بر تنوع ( مرد، زن و رنگ) متمرکز شود مخصوصا رباتهای ژاپنی که به طور علنی و سر سختتر، از کلیشههای جنسیتی زنانه پیروی میکنند.

وی همچنین معتقد است که راهحل این موضوع صرفا پوشاندن پوستهای رنگی بر رباتها نیست بلکه، شخصیت و برنامهی ریزی آنها باید کاملا متفاوت باشد. مثلا: ربات معروف شخصیت سفارشی شده Bina48 طبق آناتومی و شخصیت محدود همسر یک میلیونر آفریقایی، آمریکایی طراحی شده است.

صحبت کردن در مورد مسایل نژاد پرستی با یک ربات، پوچ بی معنی خواهد بود. زیرا ربات هیچ تجربه شخصی برای سخن گفتن ندارد و همهی پاسخهای آن مبتنی بر هوش مصنوعی است که سازندگان ربات در آن قرار دادهاند. همهی این موارد حافظههای کاشته شدهای هستند که توسط انسانها بر روی آنها کارگذاری شده است. در نتیجه هر رفتاری نژاد پرستانهای از رباتها انجام شود تمام زیر سر سازندگان و مهندسان رباتها هستند. ما باید طرز تفکر انسانها و جامعه را عوض کنیم نه رباتها چرا که ربات همان کاری را انجام میدهد که برای آن توسط انسانها برنامه ریزی شده است.

علاوه بر همهی موارد فوق که به آن اشاره شد. یکی از مهمترین روشها جهت مبارزه با این میراث فرهنگی غلط، توجه به ارتباط انسانها با یکدیگر در کشورها و فرهنگهای مختلف است. با الگو برداری از این رابطه میتوان رباتهای متنوع، با شخصیتهای انسانی و به دور از هرگونه کلیشههای جنسیتی ساخت. انجام چنین کاری نوید بخش آیندهای روشن است و میتواند روابط بین انسان و ماشین را کمتر ترسناک و غیر عادی جلوه دهد. خصوصا برای افرادی که در آینده نیاز به کمک این رباتهای اجتماعی دارند. حال متوجهشدید که افکار و رسومات غلط گذشته چقدر میتوانند تاثیر گذار باشند که علاوه بر انسانها، حتی توانسته است به عمق تفکرات یک ربات نیز راه یابد.

سخن آخر

این مقاله بر اساس تحقیقات پروفسور جامعه شناس، مارک پیترسون است که در یک سازمان خبری غیر انتفاعی مستقل انتشار پیدا کرده نوشته شده است. مقاله حقایق و تحلیلهایی را برای مردم جامعه به ارمغان میآورد تا با استفاده از آن به ما کمک کند تا دنیای پیچیده و تاریکی را که بسوی آن در حال حرکت هستیم را بهتر بشناسیم.

منبع: مایکت